L’intelligence artificielle n’est plus un gadget d’innovation : elle devient un véritable levier métier.

L’autre jour, un lecteur de Wexample m’a posé une question que j’ai d’abord trouvée presque rhétorique :

« On peut vraiment utiliser l’IA en entreprise sans finir sur la sellette juridique ? »

Une question qui revient souvent, et à juste titre.

L’intelligence artificielle ouvre des perspectives fantastiques : automatisation, détection d’anomalies, aide à la décision, réduction des coûts… Mais elle vient aussi bousculer les habitudes, les process, et parfois la conformité.

Et si, plutôt que de voir l’IA comme une boîte noire incontrôlable, on la traitait comme ce qu’elle est vraiment : une technologie puissante à piloter avec méthode ?

💡 Et si on prenait l’IA au sérieux, comme n’importe quel projet stratégique ?

💡 Et si on structurait sa mise en œuvre avec autant de rigueur que pour un ERP ou une certification qualité ?

C’est là que l’audit, la documentation, et la gouvernance entrent en jeu. Non pas pour freiner, mais pour accélérer avec assurance.

Décryptage | Que se passe-t-il quand une IA entre dans une entreprise ?

Une IA, aussi brillante soit-elle, ne peut pas être intégrée comme un simple plugin.

Elle manipule des données, produit des décisions, influence des processus métiers…

Et dans certains secteurs — santé, finance, sécurité, éducation — elle entre directement en collision avec des réglementations strictes.

Mais au fond, c’est quoi un projet sensible ?

- 👉 C’est un projet dans lequel l’IA traite des données personnelles sensibles (santé, origine ethnique, opinions, données biométriques…),

- 👉 Ou bien un projet qui manipule des informations à forte valeur stratégique, comme du secret industriel, des algorithmes maison ou des données propriétaires.

En clair : dès qu’une IA peut impacter un humain, une décision critique ou un avantage concurrentiel, elle entre dans la catégorie des projets sensibles.

Et donc…

- 👉 L’IA doit répondre aux mêmes exigences qu’un logiciel critique : sécurité, transparence, traçabilité.

- 👉 Elle doit pouvoir être expliquée, auditée, corrigée. En clair : elle doit être maîtrisée.

Bonne nouvelle : il existe aujourd’hui des méthodologies éprouvées pour intégrer l’IA sans se brûler les ailes.

Une IA, c’est comme un stagiaire super malin mais imprévisible. Tant que tout va bien, c’est fluide. Mais s’il fait une erreur, c’est à VOUS qu’on demandera des comptes.

Changer de perspective avec notre newsletter !

👉 Je m’inscris !- 🧠 Veille pour vos projets web

- 📦 Analyses orientées ROI

- 👁️ Regard indépendant et lucide

Analyse | Les conséquences d’un usage non encadré de l’IA en entreprise

Laisser une IA se déployer sans cadre, c’est comme lâcher un drone sans GPS dans un tunnel : ça finit mal.

Et si votre IA mettait en danger votre mise en conformité ?

Une IA qui n’a pas été pensée pour évoluer dans un cadre règlementé, c’est un peu comme une Ferrari sur un chemin de halage : rapide, mais pas du tout adaptée au terrain. Voici les principaux risques :

- 🚨 Violation du RGPD : collecte de données sensibles non justifiée, absence de base légale, pas d’AIPD.

- 🧨 Fuites de données : via les prompts, les logs, ou les API tierces non maîtrisées.

- ❌ Dépendance à une boîte noire : modèles opaques, hébergés à l’étranger, sans possibilité de contrôle ou d’audit.

- 💸 Risques business : perte de confiance client, sanctions administratives, impossibilité de certifier une solution.

Et ce n’est pas une vue de l’esprit : on parle ici de milliers d’euros de risques financiers, sans parler de l’impact réputationnel.

Quelles sont les questions à poser AVANT d’autoriser une IA ?

Ce que tout décideur devrait demander à son équipe technique (ou à son prestataire) :

- 🔐 Où vont les données ? Transitent-elles sur des serveurs à l’étranger ? Sont-elles chiffrées ?

- 🪪 Peut-on expliquer une décision prise par l’IA ? Si elle influence un humain, il faut pouvoir la justifier.

- 📜 Avons-nous une politique d’usage de l’IA ? Ou est-ce encore du freestyle complet ?

- 📎 Les modèles sont-ils versionnés ? Pour pouvoir revenir en arrière en cas de dérive.

💡 Éclairage | Et si le RGPD ne suffisait plus ?

Depuis l’adoption de l’IA Act par l’Union européenne, un nouveau cadre s’impose à tous les systèmes d’intelligence artificielle déployés sur le marché européen.

- 🤖 Les IA sont désormais classées par niveau de risque : minimal, limité, élevé ou interdit.

- 🤖 Les solutions “à risque élevé” (santé, recrutement, éducation, sécurité…) devront être enregistrées dans un registre européen et soumises à des exigences strictes de transparence et de documentation.

- 🤖 Ce cadre est complémentaire au RGPD, mais il ne le remplace pas. Dans les secteurs sensibles, les deux s’appliquent simultanément.

❤️ Bon à savoir : si une IA influence une décision humaine dans un domaine critique, il est probable qu’elle entre dans la catégorie “à risque élevé”. Demandez à votre éditeur ou prestataire s’il a déjà entamé une démarche de conformité IA Act.

Vous ne savez pas par où commencer votre audit IA ?

Je vous aide à structurer une approche claire, réaliste et adaptée à vos enjeux métiers 🤝

👉 Prendre RDV | 30 min- 🔻Identifier les bons interlocuteurs

- 🔻Construire une checklist adaptée à votre projet

- ✅Avancer en sécurité, sans tout complexifier

Enquête | Articuler l’expertise interne et l’accompagnement externe

L’audit IA en entreprise ne se résume pas à une vérification technique. Il s’agit d’un travail d’enquête, de documentation, et de coordination — exactement ce que sait faire un bon chef de projet digital.

La gestion de l’IA en entreprise repose sur une alchimie subtile entre vos équipes internes et des partenaires spécialisés.

- 🤝 L’interne connaît le métier, les contraintes, les objectifs

- 🛡️ L’externe apporte rigueur, recul et expertise réglementaire

Les profils à mobiliser :

- 🧑⚖️ Juristes RGPD/IA

- 🛡️ Experts cybersécurité

- 🎓 Chercheurs ou consultants en IA éthique

- 🏢 Organismes certificateurs pour les projets à haut risque

🎯 Le bon partenaire, c’est celui qui parle le même langage que vous — métier, tech et conformité.

💬 Le bon partenaire, c’est celui qui comprend votre environnement métier ET vos contraintes techniques.

Les rôles dans un projet IA : qui fait quoi ?

En pratique, comment articuler l’interne et l’externe ?

⚙ À retenir

- 🤖 Le chef de projet digital structure l’audit, rassemble les pièces, coordonne les actions

- 🤖 Les experts externes apportent un regard spécialisé et validé

- 🤖 La direction valide les arbitrages et engage les moyens

❤️ C’est un travail collaboratif : l’interne garantit la connaissance du terrain, l’externe apporte la rigueur du référentiel.

Besoin d’un regard structuré sur votre projet IA ?

Je propose aussi mes services pour vous aider à cadrer, documenter et auditer efficacement votre solution.

👉 Découvrir mes offres- 🟡 Atelier d’audit IA + RGPD

- 🔴 Identification des risques & dépendances

- 🟢 Roadmap de mise en conformité

Focus | Comment structurer un audit IA RGPD + cybersécurité efficace ?

Un bon audit IA ne se limite pas à cocher des cases : il permet d’aligner la technologie avec vos obligations légales et vos objectifs business.

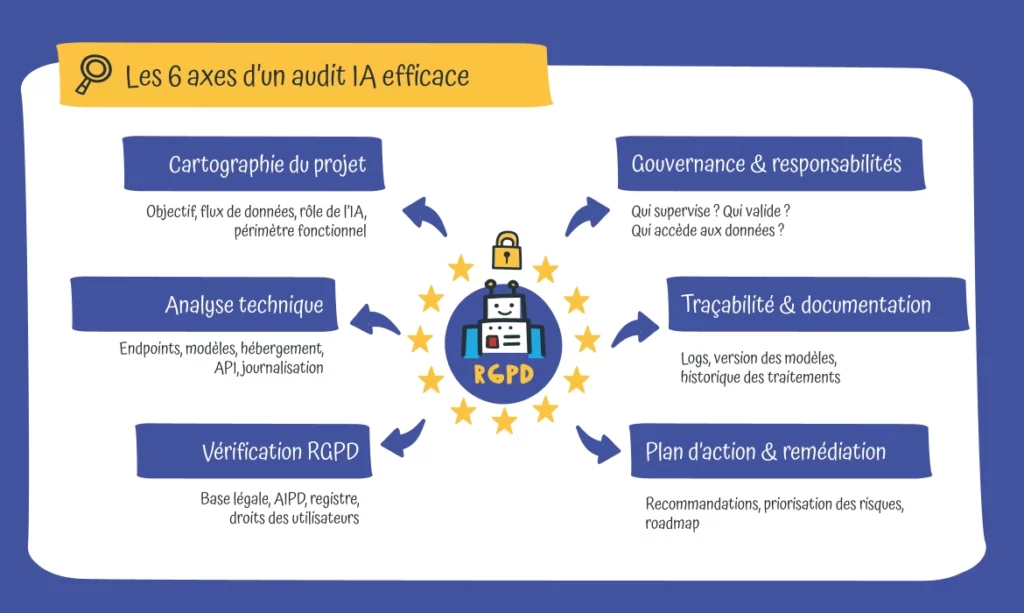

Quels sont les 6 piliers incontournables pour auditer une IA ?

Voici la base de travail que je recommande — une checklist complète, inspirée de cas réels et adaptée aux environnements sensibles :

🔵 1. Cartographie stratégique du projet

🎯 Identifier les rôles de l’IA, les flux de données et les enjeux métier

→ Pour cadrer le périmètre technique et les responsabilités dès le départ

🔵 2. Analyse technique & vulnérabilités

🔍 Examiner les endpoints, l’infrastructure, les modèles et l’exposition des données

→ Pour réduire les risques de faille, de fuite ou de dérive algorithmique

🔵 3. Conformité RGPD & IA Act

⚖️ Vérifier la base légale, les traitements déclarés et la transparence utilisateur

→ Pour éviter les sanctions et documenter les décisions automatisées

🔵 4. Gouvernance claire & pilotage

👥 Définir qui supervise, qui accède aux données, qui valide les choix IA

→ Pour garantir la redevabilité et aligner l’IA avec les objectifs métiers

🔵 5. Traçabilité & documentation de l’IA

📁 Journaliser les versions de modèles, les entrées-sorties, les incidents

→ Pour pouvoir justifier, corriger ou auditer les décisions IA à tout moment

🔵 6. Plan d’action & amélioration continue

🛠️ Formaliser les recommandations, prioriser les remédiations, planifier le suivi

→ Pour que l’audit débouche sur des actions concrètes et mesurables

⚙ À retenir

💬 Un audit IA vraiment utile ne se limite pas à une revue technique. C’est un levier stratégique pour sécuriser, justifier et piloter une solution IA dans la durée.

- 🤖 Comprendre le périmètre : quels rôles joue l’IA ? sur quelles données ? dans quel contexte métier ?

- 🤖 Identifier les risques : sécurité, biais, RGPD, dépendances techniques

- 🤖 Documenter pour durer : journalisation, version des modèles, gouvernance claire

- 🤖 Prévoir la suite : plan d’action, remédiation, roadmap conformité

❤️ Un audit bien mené, c’est un projet plus robuste, plus crédible, et plus aligné avec vos enjeux métier.

Comment démarrer sans se noyer dans la complexité ?

Pas besoin de tout faire d’un coup. Mais il faut poser les bases dès le départ :

- ✅ Documenter les flux de données dès la phase de cadrage

- ✅ Choisir des modèles open source ou auditables

- ✅ Limiter les stockages inutiles

- ✅ Impliquer un expert RGPD tôt (vraiment tôt)

☕ Conclusion

Dans les faits, oui, il est possible d’utiliser une IA dans un contexte réglementaire strict — mais pas n’importe comment. Le secret, c’est d’accepter que l’IA ne soit pas un raccourci magique, mais une couche technologique qu’il faut piloter avec rigueur.

➡️ Une IA n’est pas non plus « hors du droit ». Elle produit des décisions, manipule des données, influence des humains. Elle doit donc être encadrée avec autant, voire plus, d’exigence qu’un logiciel métier classique.

Et bonne nouvelle : avec un peu de méthode et les bons réflexes, ce niveau d’exigence est atteignable, même pour des PME. L’enjeu, ce n’est pas la taille de l’entreprise, c’est la maturité de sa gouvernance projet.

Je suis Carole Lavocat

Cheffe de projet digital | Rédactrice en chef de wexample.com, le média des projets digitaux

📩 Perspectives digitales, ma newsletter dédiée aux projets digitaux et à la stratégie digitale :

les dessous des projets numériques 👉 révélés par l’expérience du terrain.

💬 Échangeons sur LinkedIn autour de la gestion de projets digitaux et des enjeux de transformation digitale.

Besoin de clarté sur votre stratégie digitale ?

👉 Discutons ensemble pour faire avancer vos projets numériques !

Vous allez adorer !

- Maîtriser l’IA au sein de votre entreprise : entre promesses et responsabilités

- Comment les DPO peuvent rester conformes face à l’IA (sans perdre la boule)

- 🛡️ Mettre son site en conformité RGPD sans sacrifier la performance : mythe ou méthode ?